Menguasai Fine-Tuning AI: Dari Konsep hingga Implementasi Sukses

Pendahuluan

Fine-tuning pada model kecerdasan buatan (AI) membuka peluang luas bagi developer, mahasiswa, dan penggemar teknologi untuk menciptakan solusi yang presisi sesuai kebutuhan spesifik. Proses ini memungkinkan penyesuaian model AI yang telah dilatih secara umum agar mampu menguasai bidang atau kasus tertentu, dari bahasa industri hingga perilaku aplikasi real-time. Dengan pemahaman akan konsep, teknik, dan workflow fine-tuning, setiap pihak bisa meningkatkan efisiensi, menghemat sumber daya, sekaligus menyiapkan AI yang lebih cerdas dan relevan di dunia nyata.

Transfer Learning: Mengalirkan Pengetahuan ke Fine-Tuning AI Masa Kini

1. Menyelami Dasar Transfer Learning: Cara AI Memanfaatkan Pengetahuan Lama untuk Tugas Baru

Transfer learning menghadirkan revolusi signifikan dalam pengembangan model AI modern, terutama saat masuk ke ranah fine-tuning. Dengan pendekatan ini, model tidak memulai dari nol—sebaliknya, ia berdiri di atas “bahu raksasa” pengetahuan dari pelatihan sebelumnya. Model yang telah dipretrained, misalnya pada dataset besar dan beragam, telah menyerap pola, representasi, serta karakteristik umum yang berlaku luas di dunia nyata.

Proses transfer learning dimulai dengan pemilihan model yang telah memiliki fondasi kokoh. Model ini kemudian disesuaikan (fine-tuned) pada data yang jauh lebih kecil dan spesifik. Contohnya, model bahasa yang awalnya belajar dari jutaan teks, dipoles ulang agar memahami konteks layanan pelanggan di sektor perbankan. Seringkali, penyesuaian dilakukan hanya pada beberapa lapisan saja. Ada bagian fitur umum pada model yang sengaja “dibekukan” (frozen), agar tidak kehilangan pengetahuan dasar yang telah diperoleh. Sisa lapisan model boleh dibebaskan untuk berubah, menangkap nuansa unik dari domain baru.

Pendekatan inilah yang memungkinkan transfer learning menjadi efisien: data terbatas dan komputasi ringan cukup untuk mengadaptasi model secara tajam dan relevan. Selain mempercepat waktu pengembangan, biaya jauh berkurang. Model juga mampu melakukan generalisasi lebih baik pada tugas baru, sebab aktualisasi pengetahuan lamanya sudah matang. Konsep ini membuktikan pentingnya transfer learning dan fine-tuning dalam berbagai aplikasi—mulai dari otomatisasi analisis gambar medis hingga pengayaan SEO tools yang khusus bidang tertentu. Untuk mendapat gambaran implementasi AI pada bisnis di Indonesia, simak cara memanfaatkan AI untuk bisnis. Lebih dalam tentang transfer learning bisa dipelajari pada artikel IBM.

2. Menjaga dan Mengadaptasi Pengetahuan Umum: Kunci Sukses Fine-Tuning dalam Transfer Learning AI

Dalam proses fine-tuning model AI, seni utama terletak pada menjaga pengetahuan umum yang telah dipelajari oleh model sambil mengadaptasikannya untuk tugas baru yang lebih spesifik. Model pra-latih telah menyimpan wawasan luas dari data skala besar; pada tahap fine-tuning, kita harus memastikan agar wawasan fundamental tersebut tidak hilang saat model belajar dari data yang lebih sempit.

Biasanya, proses ini dilakukan dengan membekukan beberapa lapisan awal pada model. Lapisan-lapisan tersebut punya kemampuan mengenali pola dasar—seperti sintaks bahasa atau pola visual—yang bersifat universal di berbagai domain. Sementara itu, hanya lapisan-lapisan akhir yang di-update, sehingga model bisa fokus mendeteksi karakteristik khusus tanpa mengorbankan kemampuan umumnya. Hal ini jauh lebih efisien dibandingkan membangun model baru dari dasar, baik dari sisi waktu maupun kebutuhan data berlabel.

Selain membekukan lapisan, penyesuaian parameter seperti learning rate sangat penting. Pengaturan yang salah bisa membuat model kehilangan pengetahuan awal, atau malah gagal belajar tugas baru. Regulasi dengan teknik seperti dropout atau weight decay digunakan untuk mencegah overfitting, agar model tetap generalis sekaligus adaptif di domain baru.

Kombinasi strategi ini menjadikan fine-tuning dan transfer learning sangat hemat sumber daya. Misalnya, dalam penerapan AI untuk bisnis, model bahasa yang telah akrab dengan bahasa umum dapat diadaptasi menjadi spesialis industri hanya dengan set data terbatas, seperti dijelaskan pada memanfaatkan AI untuk bisnis. Pendekatan ini tidak hanya menghemat biaya dan data, tetapi juga meningkatkan relevansi serta kinerja model di aplikasi nyata. Untuk penjelasan lebih lanjut, kunjungi IBM tentang transfer learning.

Teknik Efisiensi dan Alur Kerja Optimal dalam Fine-Tuning Model AI

1. Strategi Layer Freezing: Menyempurnakan Fine-Tuning dengan Pelatihan Selektif

Dalam proses fine-tuning model AI, strategi layer freezing dan pelatihan selektif menjadi kunci dalam menjaga efisiensi alur kerja. Konsep dasar dari layer freezing adalah membekukan sebagian parameter pada layer awal model pra-latih, sehingga parameter tersebut tidak akan diperbarui selama pelatihan lanjutan. Layer awal ini biasanya sudah mampu mengenali pola umum, seperti struktur sintaks pada teks atau fitur sederhana pada gambar, yang sifatnya universal dan relevan untuk banyak tugas.

Sementara itu, layer akhir yang biasanya lebih sensitif terhadap fitur spesifik domain atau tugas tertentu, tetap dibuka dan diizinkan untuk belajar dari dataset baru. Dengan demikian, model tidak perlu mengulang seluruh proses belajar dari awal, melainkan hanya menyesuaikan bagian yang relevan tanpa kehilangan pengetahuan dasar yang telah dimiliki dari pelatihan sebelumnya. Teknik ini sangat penting ketika kita bekerja dengan dataset berukuran kecil atau sumber daya komputasi terbatas, karena hanya sebagian kecil parameter yang harus di-update, mempercepat proses dan mengurangi risiko overfitting. Tak heran, strategi ini menjadi dasar dalam banyak penerapan AI, termasuk adaptasi model untuk sektor customer service, SEO tools, hingga aplikasi khusus bisnis seperti yang diulas dalam pemanfaatan AI untuk bisnis.

Menentukan titik potong antara layer yang dibekukan dan yang tetap dapat dilatih adalah seni tersendiri. Jika terlalu banyak layer dibekukan, kemampuan adaptasi model ke tugas baru menjadi kurang optimal. Sebaliknya, membiarkan terlalu banyak layer untuk dilatih bisa memperlambat pelatihan atau membuat model lebih rentan terhadap overfitting. Praktik terbaik biasanya dimulai dengan membekukan mayoritas layer dan melakukan penyesuaian bertahap sesuai performa validasi. Pendekatan ini terbukti mempercepat proses fine-tuning dan memperkuat relevansi model di domain sasaran, sekaligus mengoptimalkan pemanfaatan sumber daya. Untuk pemahaman lebih lanjut tentang implementasi teknik ini pada model AI, pembaca dapat merujuk ke sumber lengkap.

2. Strategi Optimalisasi Hyperparameter: Layer Freezing dan Selective Training dalam Fine-Tuning Model AI

Dalam proses fine-tuning model AI, pengoptimalan hyperparameter menjadi inti dari efisiensi dan kinerja adaptasi model. Salah satu pendekatan kunci yang telah terbukti ampuh adalah layer freezing, yaitu membekukan beberapa lapisan pada model pralatih sehingga bobotnya tidak diperbarui selama proses pelatihan lanjutan. Praktik ini memungkinkan model mempertahankan pengetahuan generik yang telah dipelajari dari data berskala besar, sembari fokus menyesuaikan lapisan yang lebih dalam pada tugas atau domain spesifik. Upaya membekukan lapisan—khususnya pada bagian awal—dapat sangat mempercepat proses pelatihan, mengurangi kebutuhan komputasi, serta menurunkan risiko overfitting, terutama ketika data pelatihan tambahan berukuran terbatas atau perangkat keras minim.

Selain layer freezing, selective training atau pelatihan selektif menawarkan kemungkinan pengaturan granuler atas bagian mana dari model yang perlu diadaptasi. Biasanya, lapisan awal menangkap pola universal seperti fitur visual dasar untuk visi komputer atau struktur tata bahasa dalam pemrosesan bahasa alami. Dengan membekukan lapisan ini dan hanya melatih lapisan atas yang bersifat lebih spesifik, proses fine-tuning menjadi jauh lebih efisien. Keputusan mengenai titik henti (cut point) antara lapisan yang dibekukan dan yang dilatih sangat krusial. Terlalu dini membekukan dapat mengorbankan fleksibilitas model, sedangkan terlalu banyak lapisan dibuka akan meningkatkan risiko overfitting dan memperpanjang waktu pelatihan.

Beberapa strategi tambahan melibatkan penggunaan tingkat pembelajaran berbeda untuk tiap lapisan (discriminative learning rates) atau melakukan unfreezing secara bertahap. Langkah-langkah ini memadukan efisiensi dengan kemampuan adaptasi sehingga model tetap mampu menghadirkan performa optimal di domain sasaran.

Baca lebih lanjut tentang panduan freezing layer pada model AI untuk memperdalam strategi efisiensi fine-tuning.

Aplikasi dan Studi Kasus Fine-Tuning Model AI

1. Mengadaptasi Model Bahasa Besar untuk Ranah Spesifik: Strategi Fine-Tuning dan Implementasinya

Dalam penerapan teknik fine-tuning pada model bahasa besar (LLM), proses adaptasi khusus untuk domain tertentu menjadi kunci agar AI mampu memberikan jawaban yang lebih akurat dan relevan. Model bahasa umum memang telah memahami pola dan kosa kata luas, namun dalam sektor-sektor seperti kesehatan, keuangan, atau hukum, ketelitian bahasa dan jeroan pengetahuan menjadi syarat utama. Fine-tuning domain-spesifik berangkat dari model dasar (foundation model) yang telah dilatih secara masif, lalu disesuaikan ulang menggunakan data yang benar-benar mewakili ranah tersebut.

Salah satu pendekatan awal adalah melalui prompt engineering, yakni merancang instruksi atau pertanyaan dengan struktur tertentu agar AI merespons sesuai konteks domain. Meski teknik ini dapat memberikan peningkatan instan, ia tidak mengubah internal model sehingga terbatas untuk kasus yang sangat spesifik. Untuk cakupan dan pemahaman mendalam, diperlukan fine-tuning penuh: seluruh atau sebagian bobot model dioptimalkan dengan data label khusus ranah, sehingga istilah teknis dan nuansa lokal bisa dipahami dan diproses secara tepat.

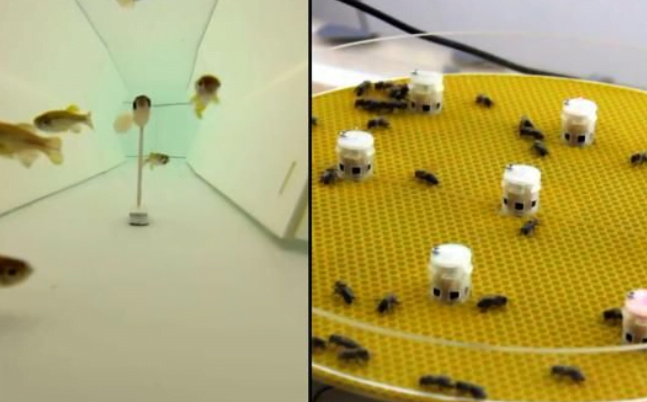

Inovasi dalam metode fine-tuning kini mengedepankan efisiensi seperti Low-Rank Adaptation (LoRA) untuk menghemat sumber daya, maupun integrasi transfer learning dan retrieval-augmented generation (RAG) demi hasil lebih presisi. Proses ini biasanya melibatkan kurasi data yang seksama, training jobs terpadu, validasi hasil, serta monitoring pasca-deploy guna memastikan model tetap mengikuti dinamika kebutuhan domain.

Strategi domain adaptation memungkinkan adopsi AI yang lebih efektif di industri spesifik. Model yang telah difine-tune secara tepat akan memiliki pemahaman jargon dan konteks, sangat cocok diimplementasikan untuk aplikasi seperti chatbot customer service atau alat SEO tools unggulan, sebagaimana dibahas dalam software SEO tools untuk analisis kompetitor. Untuk mempelajari lebih lanjut tentang proses dan contoh domain-specific LLM, kunjungi SuperAnnotate Blog.

2. Menilai Kinerja dan Dampak Fine-Tuning Model AI: Efisiensi, Relevansi, dan Tantangan di Ranah Spesifik

Evaluasi performa dan dampak fine-tuning pada model AI menjadi aspek sentral dalam penerapan di bidang spesifik. Proses ini kerap dimulai dengan pemilihan model dasar terlatih secara umum, yang kemudian diadaptasi melalui fine-tuning memakai data relevan dengan domain tertentu. Hal ini memungkinkan model memahami terminologi, konteks, hingga logika khas industri yang tidak selalu tercakup dalam model umum. Salah satu keunggulan terbesar pendekatan ini ialah efisiensi sumber daya: dengan melatih ulang hanya bagian tertentu dari model, waktu dan biaya dapat ditekan dibanding pelatihan dari awal.

Pengukuran kinerja model hasil fine-tuning biasanya membandingkan output sebelum dan sesudah adaptasi domain. Penyesuaian ini terbukti meningkatkan akurasi serta relevansi jawaban, terutama untuk kebutuhan seperti tanya jawab medis atau analisis keuangan. Selain itu, konsistensi penanganan istilah dan konteks teknis dapat dicapai, sehingga model lebih andal dalam aplikasi dunia nyata.

Namun, proses fine-tuning juga membawa tantangan: dataset harus terstruktur dan berkualitas agar model benar-benar belajar dari data domain. Selain itu, menyeimbangkan antara kedalaman pembelajaran khusus dan fleksibilitas model kerap menjadi dilema, terutama pada domain yang regulasi dan etikanya ketat. Untuk mengatasi keterbatasan data atau sumber daya, banyak pengembang kini menggunakan teknik hemat parameter seperti Low-Rank Adaptation (LoRA) atau retrieval-augmented generation, yang mengoptimalkan kinerja tanpa mengorbankan efisiensi. Dengan pipeline yang baik, mulai dari validasi hingga monitoring pasca-deploy, fine-tuning model AI bisa memberikan keunggulan kompetitif nyata di berbagai sektor industri.

Pelajari lebih jauh tentang implementasi AI dalam bisnis melalui memanfaatkan AI untuk bisnis dan temukan detail lanjutannya di SuperAnnotate’s blog.

Kesimpulan

Fine-tuning model AI menjadi jalan tengah efisien antara inovasi dan optimalisasi. Dengan memanfaatkan transfer learning, teknik pengembangan efisien, serta berbagai aplikasi praktis, developer dan pelaku bisnis dapat memaksimalkan potensi model pretrained untuk menyelesaikan tantangan spesifik secara efektif. Konsistensi pemahaman workflow serta studi kasus aplikatif dapat menjadi inspirasi dan pijakan untuk menciptakan solusi AI yang unggul dan strategis di berbagai lini.

Bangun keunggulan AI bersama fine-tuning: terapkan prinsip-prinsip ini untuk solusi yang presisi dan hemat sumber daya. Majapahit Teknologi Nusantara siap mendampingi Anda merancang otomasi dan AI yang inovatif, efisien, dan sesuai dengan kebutuhan spesifik bisnis Anda. Lawan inefisiensi & akselerasi transformasi digital bersama tim ahli kami.

Tentang Kami

Majapahit Teknologi Nusantara adalah perusahaan konsultan visioner yang mengkhususkan diri pada solusi berbasis kecerdasan buatan (AI). Tim kami membantu bisnis menyederhanakan proses, mengurangi inefisiensi, dan mempercepat transformasi digital. Dengan memanfaatkan kecerdasan buatan mutakhir dan teknologi otomatisasi cerdas, kami menghadirkan strategi yang disesuaikan untuk mendorong inovasi dan membuka peluang pertumbuhan baru. Baik Anda ingin mengotomatisasi tugas rutin maupun mengintegrasikan sistem yang kompleks, Majapahit siap memberikan panduan ahli agar bisnis Anda tetap unggul di lanskap digital yang terus berkembang.

Tren Mingguan

Dalam era digital ini, internet membuka [...]

Di era digital saat ini, keterampilan [...]

Keamanan siber merupakan hal yang sangat [...]

Perkembangan teknologi komunikasi telah membuka peluang [...]

Git adalah salah satu sistem kontrol [...]

Trafik website adalah salah satu indikator [...]

Di zaman yang serba terhubung ini, [...]

Dalam dunia pemrograman, proses transformasi kode [...]